Apple développe de nouvelles façons d’interagir avec les Animojis en tirant parti des effets sonores appropriés pour chaque avatar, qui est activé lorsque les utilisateurs prononcent certains mots ou font des expressions spéciales lors d’une session d’enregistrement.

Initialement lancés avec l’iPhone X, les Animojis ont immédiatement séduit les utilisateurs (surtout aux États-Unis), qui sont de plus en plus utilisés sur iMessage ou pour créer de belles vidéos à partager sur les réseaux sociaux. Au cours de leurs 12 premiers mois, Apple a apporté des améliorations telles que la reconnaissance des langues ou Memoji, qui vous permettent de créer des avatars personnalisés.

Un nouveau brevet nous montre maintenant ce qui pourrait être la prochaine mise à jour d’Animoji. En particulier, il est fait référence à la possibilité d’activer des effets vocaux basés sur des expressions faciales.

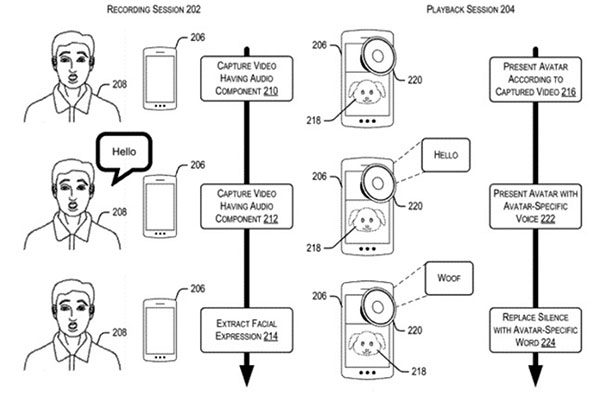

Lors de l’enregistrement d’un message Animoji, iOS enregistre les mouvements du visage et le son du sujet. Actuellement, le suivi du visage est mappé directement sur le personnage, les mouvements de l’utilisateur étant reflétés aussi fidèlement que possible, tandis que la piste audio correspond exactement à ce que l’iPhone détecte lors de l’enregistrement.

Le nouveau brevet prévoit que le logiciel active des effets audio et vocaux particuliers basés sur des expressions faciales, et ne se limite pas à répéter ce que le microphone perçoit pendant l’enregistrement. Par exemple, si le sujet fronce les sourcils, un son de colère peut apparaître sur l’Animoji. Une fois cet effet activé, l’avatar peut passer par une animation prédéfinie ou modifier l’expression réelle affichée par l’utilisateur, tandis que le discours peut être déplacé ou complètement remplacé.

Par exemple, si vous utilisez un avatar de chien, l’utilisateur peut dire le mot « aboie » et Animoji émettra le son d’aboiement, modifiant également l’expression de l’utilisateur pour l’associer au son de « wouaf ».

Bien que cette idée ne soit encore qu’à l’état de brevet, il n’est pas impossible de la voir débarquer dans iOS 13 l’année prochaine.

Sera-ce une des nouvelles fonctionnalités d’iOS 13?